به گزارش وبسایت اخبار جهان به نقل از تابناک و بر اساس گزارش عصرایران، یک مرد ۶۰ ساله پس از دریافت مشاوره از چت جی پی تی (ChatGPT)، اقدام به جایگزینی نمک خوراکی با برومید سدیم نمود، که این اقدام منجر به مسمومیت با برومید و بستری شدن وی به مدت سه هفته در بخش روانپزشکی گردید.

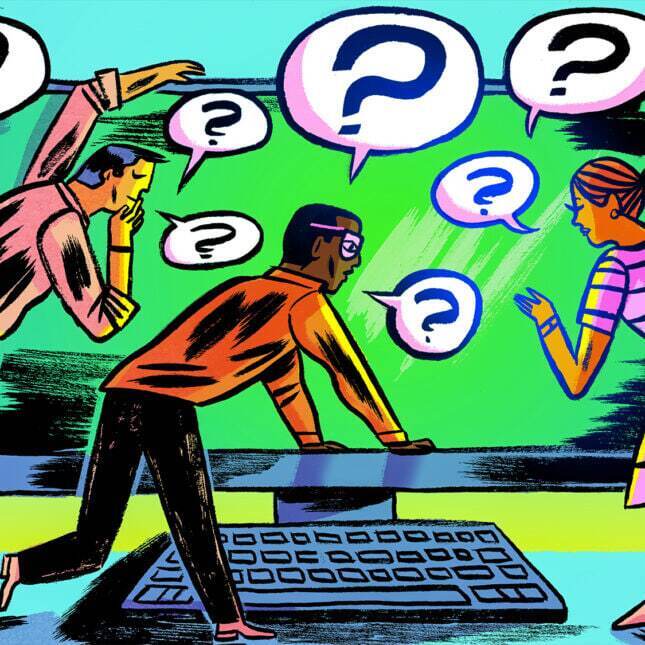

شاید این خبر در نگاه اول خندهدار به نظر برسد یا این مرد را ناآگاه بدانید، اما واقعیت این است که تقریباً تمامی افراد با دسترسی به اینترنت حداقل یک بار سوالی مرتبط با حوزه سلامت را از چت جی پی تی پرسیدهاند و این موضوع برای بسیاری از کاربران به یک عادت روزانه تبدیل شده است. این اتفاق، خطرات احتمالی اتکا به رباتهای چت هوش مصنوعی برای دریافت مشاورههای سلامتی را نشان میدهد. با این وجود، طبق یک نظرسنجی جدید، اکثر آمریکاییها اطلاعات سلامتی تولید شده توسط هوش مصنوعی را «تا حدی قابل اعتماد» میدانند. متخصصان هشدار میدهند که ابزارهای هوش مصنوعی نباید به هیچ عنوان جایگزین مراقبتهای پزشکی تخصصی شوند.

رباتهای چت هوش مصنوعی به سوابق پزشکی شما دسترسی ندارند و به همین دلیل نمیتوانند در مورد علائم جدید، شرایط موجود یا نیاز شما به مراقبتهای اورژانسی، راهنمایی قابل اطمینانی ارائه دهند. به گفته دکتر مارگارت لوزواتسکی، مدیر ارشد اطلاعات پزشکی و معاون نوآوریهای سلامت دیجیتال در انجمن پزشکی آمریکا، توصیههای سلامتی ارائه شده توسط رباتهای چت هوش مصنوعی اغلب بسیار کلی هستند.

به گفته وی، بهترین کاربرد فعلی هوش مصنوعی، استفاده از آن برای کسب اطلاعات پایه به منظور کمک به طرح سوالات دقیقتر از پزشک یا توضیح اصطلاحات پزشکی است که برای شما ناآشنا هستند. اطلاعات ارائه شده توسط هوش مصنوعی ممکن است قدیمی یا نادرست باشد. هوش مصنوعی مولد (Generative AI) به دادههایی متکی است که با آنها آموزش داده شده است و این دادهها ممکن است بازتابدهنده آخرین دستورالعملهای پزشکی نباشند. به عنوان مثال، مراکز کنترل و پیشگیری از بیماری آمریکا اخیراً واکسن آنفولانزای بهروز شده را برای همه افراد بالای ۶ ماه توصیه کردهاند، اما ممکن است برخی از رباتهای چت از این موضوع آگاهی نداشته باشند.

حتی زمانی که یک ربات چت هوش مصنوعی دچار اشتباه میشود، میتواند با اطمینان و به شکلی قانعکننده به نظر برسد. سیستمهای هوش مصنوعی ممکن است برای پر کردن شکافهای اطلاعاتی، دادهها را به هم پیوند داده و پاسخهای نادرست یا گمراهکننده ارائه دهند.

مطالعهای که در مجله Nutrients به چاپ رسید، نشان داد که رباتهای چت معروفی مانند جمنای، مایکروسافت کوپایلت و چت جی پی تی قادر به تولید برنامههای غذایی مناسب برای کاهش وزن هستند، اما در ایجاد تعادل بین مواد مغذی اصلی، شامل کربوهیدراتها، پروتئینها، چربیها و اسیدهای چرب، موفق عمل نمیکنند.

به گفته دکتر آینسلی مک لین، مشاور هوش مصنوعی سلامت و افسر ارشد سابق هوش مصنوعی در گروه پزشکی میدآتلانتیک کایزر پرمننته، او تمایلی ندارد به بیماران توصیه کند که صرفاً بر اساس توصیههای چت جی پی تی عمل کنند.

آیا روشی ایمن برای استفاده از ابزارهای هوش مصنوعی در زمینه سلامت وجود دارد؟ دکتر مک لین خاطرنشان کرد که رباتهای هوش مصنوعی مولد در حال حاضر تحت پوشش قوانین حفظ حریم خصوصی سلامت مانند HIPAA قرار ندارند. او هشدار داد: “اطلاعات شخصی سلامت خود را در این ابزارها وارد نکنید. این اطلاعات ممکن است به هر جایی درز کند.”

هنگامی که خلاصههای تولید شده توسط هوش مصنوعی را در گوگل بررسی میکنید، بهتر است بررسی کنید که آیا این اطلاعات از یک مجله علمی یا سازمان پزشکی معتبر تهیه شده است یا خیر. همچنین، تاریخ انتشار اطلاعات را بررسی کنید تا از بهروز بودن آن اطمینان حاصل کنید.

دکتر لوزواتسکی ابراز امیدواری کرد که افراد در صورت تجربه علائم جدید، همچنان به پزشک خود مراجعه کنند و در مورد اطلاعاتی که از طریق یک ربات چت هوش مصنوعی به دست آوردهاند و هر اقدامی که بر اساس آن انجام دادهاند، با پزشک خود صادقانه صحبت کنند.

او افزود که کاملاً منطقی است که اطلاعات به دست آمده از هوش مصنوعی را با پزشک خود در میان بگذارید و از او بپرسید: “آیا این اطلاعات دقیق است؟ آیا در مورد من صدق میکند؟ و اگر نه، چرا؟” همچنین میتوانید از پزشک خود بپرسید که آیا ابزار سلامت هوش مصنوعی خاصی وجود دارد که او به آن اعتماد دارد یا خیر.

به طور خلاصه، توصیههای سلامتی تولید شده توسط هوش مصنوعی میتوانند خطرناک باشند و نباید به عنوان جایگزینی برای راهنماییهای یک متخصص پزشکی مجاز مورد استفاده قرار گیرند. رباتهای چت هوش مصنوعی ممکن است اطلاعات سلامتی قدیمی، گمراهکننده یا بیش از حد کلی ارائه دهند. کارشناسان توصیه میکنند که از ابزارهای هوش مصنوعی فقط برای کسب دانش کلی و زمینهای استفاده کنید و حتماً هر گونه توصیه سلامتی که از طریق هوش مصنوعی به دست آمده است را با پزشک خود در میان بگذارید.

منبع : تابناک